تقييم تهديد الذكاء الاصطناعي من خلال تقارير الحوادث

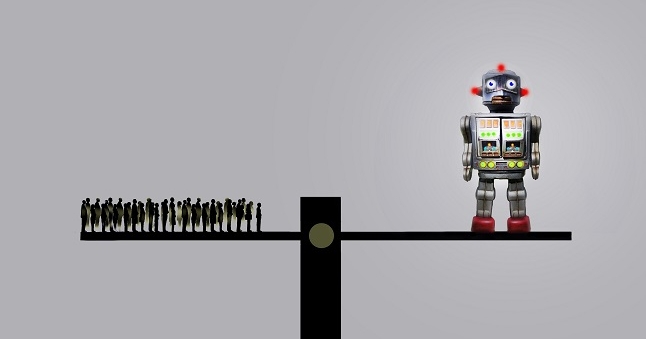

ال قاعدة بيانات حوادث الذكاء الاصطناعي يؤرخ أكثر من 2000 حادثة تسبب فيها الذكاء الاصطناعي في حدوث ضرر. إنه رقم جدير بالاهتمام ويستمر في النمو بشكل مشؤوم. لكن الشيطان يكمن في التفاصيل، ومجرد الإحصاء لا يوفر تفاصيل كافية عن درجات الأذى أو النوايا الخبيثة. إن التظاهر بأن الذكاء الاصطناعي آمن هو حماقة محضة، لكن تخيل أنه يجلب الهلاك هو أمر حمقاء بنفس القدر. للحصول على قراءة أكثر واقعية للضرر الذي سببه الذكاء الاصطناعي والذي من المحتمل أن يسببه، إليك نظرة فاحصة على الحوادث المبلغ عنها في العالم الحقيقي.

الهدف من معظم تقارير الحوادث هو تبادل المعرفة حول الأخطاء التي حدثت بناءً على النظرية البسيطة القائلة بأن “عدد الرؤوس أكثر أفضل من رأس واحد” في إيجاد حلول دائمة ومنع تكرار المشكلة. لا تهدف هذه التقارير إلى تخويف أو تهدئة الجمهور، ولا تهدف إلى أن تكون مادة لنظريات المؤامرة أو العلوم السيئة.

ومع ذلك، لا يتم إنشاء جميع تقارير الحوادث بشكل متساوٍ، وهذا ينطبق على جميع المنتجات والصناعات، مما يعني أنها لا تقتصر حتى على تقارير الذكاء الاصطناعي.

تتضمن أمثلة تقارير الحوادث ذات السمعة الطيبة ما يلي: قاعدة بيانات حوادث الذكاء الاصطناعي، وهو مشروع تعاوني للذكاء الاصطناعي المسؤول. هذه منظمة غير ربحية تم تأسيسها للبناء على قاعدة بيانات حوادث الذكاء الاصطناعيوهو مشروع مفتوح المصدر يحظى بدعم ومشاركة عالمية.

مثال آخر على تقرير حوادث الذكاء الاصطناعي حسن السمعة هو مستودع AIAAIC، والتي تعني حوادث وخلافات الذكاء الاصطناعي والخوارزمية والأتمتة. إنه مورد عام يعرض تفاصيل الحوادث والخلافات “التي يقودها ويتعلق بالذكاء الاصطناعي والخوارزميات والأتمتة، بطريقة موضوعية ومتوازنة ومنفتحة”. يمكن لأي شخص الوصول إلى البيانات إما على موقع مستودع AIAAIC أو كملف ورقة جوجل.

قبل أن يندفع أي شخص للبحث عن علامات ذكاء اصطناعي صاعد يستحق قصة رعب خيال علمي في هذه التقارير، استعد لمواجهة المزيد من الأسباب الدنيوية وراء الحوادث.

يقول أشو دوبي، المؤسس المشارك والرئيس التنفيذي لشركة، إن حوادث الذكاء الاصطناعي هي “تسمية خاطئة”. جلين.اي. تُظهر قاعدة بيانات حوادث الذكاء الاصطناعي “حوادث مستخدمي الذكاء الاصطناعي”، كما يقول دوبي، وهي عبارة عن حساب للأخطاء البشرية أكثر من إخفاقات الذكاء الاصطناعي.

يقول دوبي: “الحقيقة هي أن معظم هذه التقارير تتحدث عن مستخدمين يستخدمون الذكاء الاصطناعي مثل ChatGPT لحل المشكلة الخاطئة، ثم يصابون بالهلوسة باستخدام ChatGPT”. هلوسة الذكاء الاصطناعي تعني أن الذكاء الاصطناعي قرر أن استجابته تتمتع بدرجة عالية من الدقة في حين أنها في الواقع خاطئة بشكل واضح ولا يمكن إنكاره.

من الناحية العملية، يمكن أن تكون العواقب في العالم الحقيقي مدمرة بنفس القدر سواء كانت ناجمة عن خطأ بشري، أو ذكاء اصطناعي مهلوس، أو ذكاء اصطناعي معادي. ومن الناحية العملية بنفس القدر، لهذا السبب يتم بذل جهد أقل نحو إلقاء اللوم وأكثر توجيهًا نحو حل القضايا الأساسية.

تشرح هدى حيدري، قائدة الذكاء الاصطناعي المسؤولة في مركز بلوك بجامعة كارنيجي ميلون، أن “حوادث الذكاء الاصطناعي على مستوى عالٍ تشير إلى نتائج سلبية أو آثار جانبية غير مقصودة ينتجها الذكاء الاصطناعي فقط أو جزئيًا”.

قياس تهديد الذكاء الاصطناعي من خلال تحليل الحوادث

تميل حوادث الذكاء الاصطناعي إلى الانطلاق من أحد الاتجاهات الثلاثة.

“يتم تحديد جودة مخرجات الذكاء الاصطناعي من خلال ثلاثة عوامل: أولاً، النموذج الأساسي. ثانياً، نوعية البيانات المغذية لها. “ثالثًا، السؤال أو السؤال المطروح على الذكاء الاصطناعي،” كما يقول آرتي رامان، الرئيس التنفيذي ومؤسس الشركة تيتانيام.

تاريخيًا، يقع العبء على صانعي الذكاء الاصطناعي فيما يتعلق بالأخطاء والحوادث.

تحليل بيانات الحادث في قاعدة بيانات حوادث الذكاء الاصطناعي بواسطة برنامج مكافحة الفيروسات وموفر VPN Surfshark وجدت أنه حتى وقت قريب، كانت OpenAI وTesla متعادلتين في 41 حالة، مع احتلال Facebook الصدارة بـ 48 حالة في مجموعة البيانات الإجمالية. ومع ذلك، تفوقت OpenAI على فيسبوك في معظم الحوادث التي وقعت في عام 2023.

تقول أغنيسكا سابلوفسكايا، الباحثة الرئيسية في Surfshark: “على الرغم من الفرص التي يوفرها الذكاء الاصطناعي، فإن العدد المتزايد من الحوادث المرتبطة بالذكاء الاصطناعي يسلط الضوء أيضًا على المخاوف، بما في ذلك التزييف العميق الناتج عن الذكاء الاصطناعي، والتحيز الخوارزمي، وحوادث السيارات المستقلة”.

وتقول: “يكشف تحليل البيانات لدينا أن فيسبوك واجه عددًا أكبر من حوادث الذكاء الاصطناعي بين عامي 2020 و2021”. “ومع ذلك، فقد انخفض تواترها منذ ذلك الحين، ربما بسبب تخصيص الموارد لمعالجتها. يوضح هذا المثال أن المشكلات المتعلقة بالتكنولوجيا الجديدة متوقعة، إلا أن معالجتها على الفور أمر حيوي لضمان أن يكون الابتكار مفيدًا أكثر من كونه ضارًا.

يقول مراقبون وخبراء آخرون في الصناعة إن هناك تأثيرًا أكبر على زيادة عدد الحوادث في OpenAI أكثر مما قد يكون واضحًا بسهولة.

“إذا نظرت إلى حوادث الذكاء الاصطناعي على مدى السنوات الخمس الماضية، ستلاحظ أنه طالما أن منتج الذكاء الاصطناعي يتحكم في جميع العوامل الثلاثة، أي النموذج، والبيانات، والأسئلة المطروحة على النموذج، وعدد الحوادث و وكانت شدتها تحت السيطرة بشكل جيد. يقول رامان: “هذا هو الحال مع شركتي تيسلا وفيسبوك سابقًا”.

ويضيف رامان: “بمجرد أن أصبح الذكاء الاصطناعي متاحًا على نطاق واسع وأصبح من الممكن لأي شخص الاستعلام عن النماذج، بدأنا نشهد المزيد من الحوادث – ويتضح ذلك من خلال الحوادث المتعلقة بـ OpenAI”.

يبقى أن نرى ما إذا كانت ملاحظة رامان صحيحة مع مرور الوقت. ولكن صحيح أن المزيد من الأشخاص الذين يستخدمون الذكاء الاصطناعي لمزيد من المهام غالبًا ما يؤدي إلى تضخيم عدد الحوادث.

“نظرًا لأن أنظمة الذكاء الاصطناعي أصبحت أكثر قوة ويمكن الوصول إليها على نطاق واسع، مثل ChatGPT، فإن نطاق مجالات التطبيقات والمهام التي تستخدم فيها تقنيات الذكاء الاصطناعي لتلعب دورًا مهمًا يتسع باستمرار. تقول هدى حيدري، الأستاذة المساعدة في التعلم الآلي والحوسبة المجتمعية في مركز بلوك بجامعة كارنيجي ميلون: “يتعين علينا أن نتوقع توسع حجم وخطورة حوادث الذكاء الاصطناعي”.

تهدف منظمات مثل حركة الذكاء الاصطناعي المسؤول إلى الحد من الحوادث وتقليل الأضرار التي تلحق بالمجتمع ككل والأفراد على وجه الخصوص. لكن الكثيرين يقولون إن الجهود التطوعية ليست كافية.

“في حين أن قواعد بيانات حوادث الذكاء الاصطناعي من الشراكة من أجل الذكاء الاصطناعي، مشروع أطلس من MITRE، وحدث الفريق الأحمر DEFCON الذي تم تنظيمه مؤخرًا و الالتزامات الطوعية يقول رامايا كريشنان، مدير هيئة التدريس في مركز بلوك بجامعة كارنيجي ميلون: “إنها خطوات مهمة للأمام، ولا بد من إيجاد حل مؤسسي”.

إجماع الصناعة هو أن تدابير سلامة الذكاء الاصطناعي هي في نهاية المطاف مسؤولية الجميع. ولكن من المهم تجنب كل من المبالغة في رد الفعل والتقليل من رد الفعل لأن كلاهما ضار. ومع ذلك، فإن العثور على منطقة المعتدل يمثل تحديًا صعبًا.

“إن ما لا نفهمه تمامًا غالبًا ما يخيفنا، ونتصرف كما فعلت سامسونج حظر نماذج الذكاء الاصطناعي بشكل كامل. ولكن هناك أرضية مشتركة يمكن العثور عليها من شأنها إنشاء حواجز الحماية اللازمة دون إعاقة الابتكار المستمر. يقول ألون يامين، الرئيس التنفيذي والمؤسس المشارك لشركة “إن التقنيات التي يمكنها تحديد سياسات الذكاء الاصطناعي العام وإنفاذها تسمح بوجود حل وسط، حيث يمكن أن يزدهر الابتكار بينما يتم اعتماد الذكاء الاصطناعي التوليدي بشكل مسؤول”. التسريبات، أداة كشف الانتحال والمحتوى المستندة إلى الذكاء الاصطناعي.