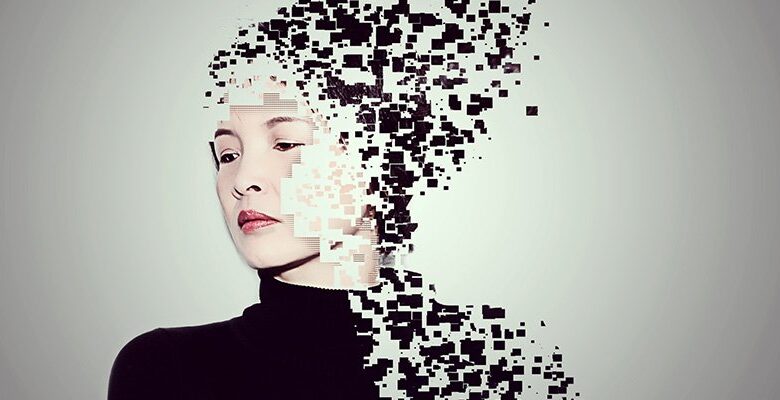

إعادة التفكير في الهوية في عصر انتحال شخصية منظمة العفو الدولية

لعقود من الزمن ، الثقة في الأعمال التجارية تتوقف على الغرائز البشرية البسيطة. كان الأمر كذلك عندما رأينا وجهًا مألوفًا أو سمعنا صوتًا موثوقًا به ، كنا نعتقد غريزينا أننا نتعامل مع الشخص الحقيقي. هذا الافتراض الآن خطير.

في الـ 18 شهرًا الماضية ، انتقلت Deepfakes من الجدة إلى السلاح. أصبح ما بدأ كمزاحات الإنترنت الخرقاء مجموعة أدوات مجرم إلكترونية ناضجة. تم خداع الفرق المالية في الأسلاك الملايين بعد مكالمات الفيديو مع “المديرين التنفيذيين” الذين لم يسبق لهم تسجيل الدخول. تم انتحال شخصية وزير الخارجية في فلوريدا للاتصال بوزراء الخارجية. حتى الرئيس التنفيذي لشركة فيراري تم انتحال شخصية في محاولة الاحتيال. هذه ليست حالات الحافة. إنها لمحة عما سيأتي.

يتم قياس التكلفة ليس فقط في المال ، ولكن في تآكل الثقة. عندما لم يعد بإمكاننا تصديق ما نراه أو نسمعه ، يبدأ أساس الثقة الرقمية في الانهيار.

لماذا الآن؟

ما تم تغييره ليس نية. كان المحتالون دائمًا مبتكرين. ما تم تغييره هو إمكانية الوصول. AI التوليدي (Genai) قد ديمقراطي الخداع. ما هو مطلوب من قبل المختبرات المتخصصة وقوة الحوسبة الثقيلة يمكن الآن القيام به مع تطبيق وجهاز كمبيوتر محمول. إن مقطع صوتي واحد مكتظ من ندوة عبر الإنترنت ، أو حفنة من صور شخصية على وسائل التواصل الاجتماعي ، يكفي لإنشاء صوت أو وجه موثوق به.

نحن نرى بالفعل تداعيات. غارتنر بحث وجدت أن 43 ٪ من قادة الأمن السيبراني قد شهدوا مكالمة صوتية واحدة على الأقل من DeepFake ، و 37 ٪ واجهوا DeepFakes في مكالمات الفيديو. الجودة تتحسن ، ويسارع مستوى الصوت ، وقد انهار حاجز الدخول.

التكنولوجيا وحدها لا يمكن أن تنقذنا

البائعون لم يقفوا الساكنة. يقوم مقدمو التعرف على الصوت بتضمين اكتشاف DeepFake في منصاتهم ، باستخدام الشبكات العصبية لتسجيل احتمال أن يكون المتصل اصطناعيًا. أنظمة التعرف على الوجه هي طبقات في عمليات فحص lify ، وفحص البيانات الوصفية والقياس عن بعد للجهاز لاكتشاف علامات التلاعب. هذه تطورات ضرورية ، لكنها ليست كافية.

الكشف هو دائما رد الفعل. الدقة ضد مزيفة الشهر الماضي لا تضمن الحماية ضد هذا الأسبوع. والنتائج احتمالية: عودة الأنظمة درجات المخاطر ، وليس اليقين. هذا يترك المنظمات تتخذ قرارات صعبة على نطاق واسع: من الذي تثق به ، من يجب تحديه ، بناءً على إشارات لا يمكن أن تكون مثالية أبدًا.

الحقيقة هي أنه لا توجد أداة اكتشاف يمكن أن تحمل وزن الدفاع من تلقاء نفسها. مشكلة DeepFake تتعلق بقدر ما يتعلق بالأشخاص والعمليات كما هي عن الخوارزميات.

نقطة الضعف البشرية

التكنولوجيا ليست سوى نصف المعركة. لم يتم تجاوز الحوادث الأكثر تكلفة من DeepFake حتى الآن. لقد خدعوا الناس. يُطلب من الموظفين ، في كثير من الأحيان تحت الضغط ، التصرف بسرعة: “نقل الأموال” ، “إعادة تعيين MFA الخاص بي” ، “انضم إلى هذه المكالمة الفيديو غير المجدولة”. أضف وجهًا موثوقًا أو صوتًا مألوفًا ، ويتبخر التردد.

هذا هو المكان الذي يحتاج فيه CISO وقادة إدارة الأمن وإدارة المخاطر إلى الحصول على براغماتية. يجب ألا يتم وضع الموظفين في وضع يمكن أن تؤدي فيه مكالمة هاتفية أو دردشة فيديو واحدة إلى إجراء عمل كارثي. إذا كان الطلب أكثر عاجلاً ، إذا كان ينطوي على المال أو الوصول ، فيجب أن يتم دعمه بإثبات إضافي.

هذا ليس عن إبطاء العمل. يتعلق الأمر ببناء المرونة. طرح سؤال على ذلك فقط الشخص الحقيقي الذي يعرفه ، أو تصعيد الطلبات الحساسة من خلال قنوات مستقلة ، أو تفرض مصادقة متعددة العوامل المقاومة للتصيد قبل الموافقات ، فهذه هي الدرابزين التي تمنع مزيفة من أن تصبح عملية احتيال. في بعض الأحيان تكون أبسط التقنيات هي الأكثر فعالية.

المعركة من أجل الثقة

الآثار المترتبة على يتجاوز خسائر الشركات. تقوم Deepfakes الآن بتغذية حملات التضليل ، وتنشر الأكاذيب السياسية ، وتآكل الثقة في المؤسسات العامة. في بعض الحالات ، يتم رفض لقطات حقيقية على أنها “أخبار مزيفة”. حتى الأصالة تحت الشك.

بدأت الحكومات في الرد. قدمت الدنمارك والمملكة المتحدة أو تفكر في قوانين جديدة لتجريم إنشاء ومشاركة العميق الصريحة الجنسية. في الولايات المتحدة ، يجعل التشريعات الجديدة وسائل الإعلام Deepfake غير قانونية غير قانونية بشكل صريح. هذه خطوات مهمة ، لكن القانون وحده لا يمكنه مواكبة سرعة الذكاء الاصطناعي.

بالنسبة للشركات ، تكون المسؤولية فورية ولا مفر منها. لا يمكن ل CISO الانتظار لحل تنظيمي مثالي. إنهم بحاجة إلى افتراض أن الخداع سيكون جزءًا من كل تفاعل وتصميم منظمتهم ، وفقًا لذلك.

التصميم مع الخداع في الاعتبار

فكيف يجب أن تتصرف المنظمات؟ تكمن الإجابة في الجمع بين الضمانات التقنية ذات الطبقات والعمليات التجارية المتصلب وثقافة من الشكوك الصحية. يجب أن:

- استخدم أدوات اكتشاف DeepFake ، ولكن لا تعتمد عليها بمعزل عن غيرها.

- تأكد من أن مهام سير العمل الحرجة مثل نقل الأموال واسترداد الهوية والموافقات التنفيذية لا تعتمد أبدًا على نقطة ثقة واحدة.

- تزويد الموظفين بالتدريب والثقة لتحدي وجه مألوف على الشاشة إذا كان هناك شيء ما.

خذ أنظمة القياس الحيوي كمثال. نهج الطبقات: اكتشاف هجوم العرض التقديمي (اصطياد القطع الأثرية المعروضة في الكاميرا) ، واكتشاف هجوم الحقن (اكتشاف تدفقات الفيديو الاصطناعية) ، وإشارات السياق من الأجهزة أو سلوك المستخدم ، يبني مرونة حقيقية. في الممارسة العملية ، قد لا يكون العميق نفسه الذي تم اكتشافه ، ولكن الأنماط غير العادية التي تأتي مع استخدامها

في نهاية اليوم ، يحتاج CISOs وقادة الأمن وإدارة المخاطر إلى تحويل كيفية تفكيرهم في الهوية. لم يعد شيء يمكن افتراضه من البصر أو الصوت ؛ يجب أن يثبت.

الصورة الأكبر

نحن في عصر لم يعد فيه الرؤية مؤمنًا. يتم إعادة تعريف الهوية ، حجر الزاوية في الثقة الرقمية ، من قبل الخصوم الذين يمكنهم تصنيعها حسب الرغبة. إن المؤسسات التي تتكيف بسرعة عن طريق وضع ضمانات تقنية مع عمليات تجارية مرنة ستعمل تهديدًا. أولئك الذين لا يخاطرون ليس فقط خسائر الاحتيال بل انهيار في الثقة ، داخل وخارج جدرانهم.

لن يتم حل DeepFakes بواسطة أداة ذكية واحدة أو قرار شراء. يطالبون بتحول في العقلية: افترض أن الوجه أو الصوت أمامك قد يكون مزيفًا وتصميم أمنك وفقًا لذلك.

المهاجمين يتحركون بسرعة. والسؤال هو ما إذا كان يمكن للمدافعين التحرك بشكل أسرع.

يستكشف محللو Gartner الهوية الرقمية والثقة في Gartner قمة الأمن وإدارة المخاطر يقام هذا الأسبوع في لندن (22-24 سبتمبر).

أكيف خان هو محلل نائب الرئيس في غارتنر