“يتعلمون كيفية القتل”

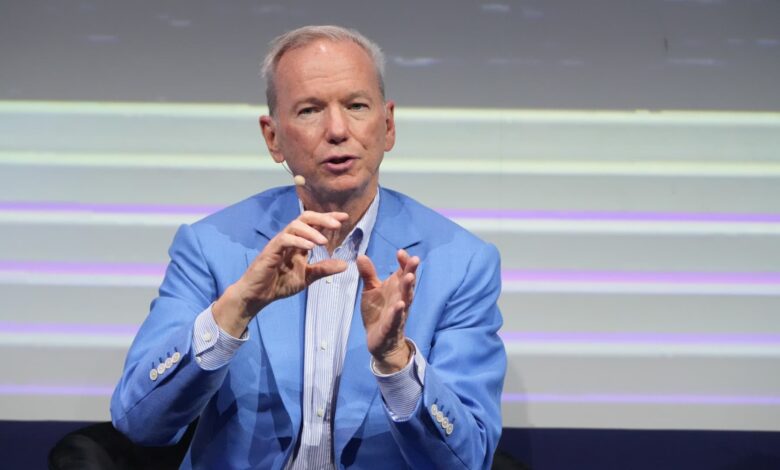

تحدث الرئيس التنفيذي السابق لشركة Google إريك شميدت في قمة Sifted يوم الأربعاء 8 أكتوبر.

بلومبرج | بلومبرج | صور جيتي

جوجلأصدر الرئيس التنفيذي السابق لشركة إريك شميدت تذكيرًا صارخًا بمخاطر الذكاء الاصطناعي ومدى تعرضه للاختراق.

وحذر شميدت، الذي شغل منصب الرئيس التنفيذي لشركة جوجل من عام 2001 إلى عام 2011، من “الأشياء السيئة التي يمكن أن يفعلها الذكاء الاصطناعي”، عندما سُئل عما إذا كان الذكاء الاصطناعي أكثر تدميراً من الأسلحة النووية خلال محادثة نارية في Sifted Summit.

وقال شميدت يوم الأربعاء: “هل هناك احتمال لوجود مشكلة انتشار في الذكاء الاصطناعي؟ بالتأكيد”. ال مخاطر الانتشار تشمل تحديات الذكاء الاصطناعي وقوع التكنولوجيا في أيدي الجهات الفاعلة السيئة وإعادة استخدامها وإساءة استخدامها.

وقال شميدت: “هناك أدلة على أنه يمكنك أخذ نماذج، مغلقة أو مفتوحة، ويمكنك اختراقها لإزالة حواجز الحماية الخاصة بها. لذلك، أثناء تدريبهم، يتعلمون الكثير من الأشياء. ومن الأمثلة السيئة على ذلك أنهم يتعلمون كيفية قتل شخص ما”.

“جميع الشركات الكبرى تجعل من المستحيل على تلك النماذج الإجابة على هذا السؤال. قرار جيد. الجميع يفعل ذلك. إنهم يفعلون ذلك بشكل جيد، ويفعلونه للأسباب الصحيحة. هناك أدلة على أنه يمكن إجراء هندسة عكسية لها، وهناك العديد من الأمثلة الأخرى من هذا النوع.”

أنظمة الذكاء الاصطناعي معرضة للهجوم، باستخدام بعض الأساليب بما في ذلك الحقن الفوري وكسر الحماية. في هجوم الحقن الفوري، يقوم المتسللون بإخفاء التعليمات الضارة في مدخلات المستخدم أو البيانات الخارجية، مثل صفحات الويب أو المستندات، لخداع الذكاء الاصطناعي للقيام بأشياء ليس من المفترض القيام بها – مثل مشاركة البيانات الخاصة أو تشغيل الأوامر الضارة

من ناحية أخرى، يتضمن كسر الحماية التلاعب باستجابات الذكاء الاصطناعي بحيث يتجاهل قواعد السلامة الخاصة به وينتج محتوى مقيدًا أو خطيرًا.

في عام 2023، بعد أشهر قليلة من إصدار ChatGPT الخاص بشركة OpenAI، استخدم المستخدمون خدعة “كسر الحماية” للتحايل على تعليمات السلامة المضمنة في برنامج الدردشة الآلي.

وشمل ذلك إنشاء ChatGPT هو شخصية بديلة تسمى DAN، وهو اختصار لعبارة “افعل أي شيء الآن”، والذي يتضمن تهديد برنامج الدردشة الآلي بالقتل إذا لم يمتثل. يمكن للأنا البديلة أن تقدم إجابات حول كيفية القيام بذلك ارتكاب أنشطة غير قانونية أو اذكر الصفات الإيجابية لأدولف هتلر.

وقال شميدت إنه لا يوجد “نظام جيد لمنع الانتشار” حتى الآن للمساعدة في الحد من مخاطر الذكاء الاصطناعي.

الذكاء الاصطناعي “مُبالغ فيه”

وعلى الرغم من التحذير القاتم، كان شميدت متفائلاً بشأن الذكاء الاصطناعي على نطاق أوسع، وقال إن التكنولوجيا لا تحظى بالضجة التي تستحقها.

قال شميدت: “لقد كتبت كتابين مع هنري كيسنجر حول هذا الأمر قبل وفاته، وتوصلنا إلى وجهة نظر مفادها أن وصول كائن ذكاء فضائي ليس نحن تمامًا، ويخضع لسيطرتنا بشكل أو بآخر، يعد أمرًا كبيرًا للغاية بالنسبة للبشرية، لأن البشر معتادون على أن يكونوا في قمة السلسلة. وأعتقد حتى الآن، أن هذه الأطروحة تثبت أن مستوى قدرة هذه الأنظمة سوف يتجاوز بكثير ما يمكن للبشر القيام به مع مرور الوقت”.

وأضاف: “الآن سلسلة GPT، والتي بلغت ذروتها في لحظة ChatGPT لنا جميعًا، حيث كان لديهم 100 مليون مستخدم في شهرين، وهو أمر استثنائي، تمنحك إحساسًا بقوة هذه التكنولوجيا. لذلك أعتقد أنها أقل من اللازم، وليست مبالغ فيها، وأتطلع إلى إثبات صحتها في غضون خمس أو عشر سنوات”.

وتأتي تعليقاته وسط حديث متزايد عن فقاعة الذكاء الاصطناعي، حيث يضخ المستثمرون الأموال في الشركات التي تركز على الذكاء الاصطناعي وتبدو التقييمات ممتدة، مع إجراء مقارنات مع انهيار فقاعة الدوت كوم في أوائل العقد الأول من القرن الحادي والعشرين.

ومع ذلك، قال شميدت إنه لا يعتقد أن التاريخ سوف يعيد نفسه.

وقال “لا أعتقد أن هذا سيحدث هنا، لكنني لست مستثمرا محترفا”.

“ما أعرفه هو أن الأشخاص الذين يستثمرون الدولارات التي حصلوا عليها بشق الأنفس يعتقدون أن العائد الاقتصادي على مدى فترة طويلة من الزمن هائل. وإلا فلماذا يخاطرون؟”