ما يحتاج مدراء تكنولوجيا المعلومات إلى معرفته حول المخاطر والثقة

تعد إدارة مصداقية الذكاء الاصطناعي والمخاطر أمرًا ضروريًا لتحقيق قيمة الأعمال من الذكاء الاصطناعي. عندما سُئل عما يجب على المؤسسات فعله للحصول على فوائد الذكاء الاصطناعي مع تقليل سلبياته، أكد بيدرو مارتينيز بويج، رئيس قسم المعلومات في مجموعة Sibelco، على الانضباط والتركيز الاستراتيجي.

وقال بويج: “إن الاستفادة من قيمة الذكاء الاصطناعي مع تقليل المخاطر يبدأ بالانضباط”. “يحتاج مدراء تقنية المعلومات ومؤسساتهم إلى استراتيجية واضحة تربط مبادرات الذكاء الاصطناعي بنتائج الأعمال، وليس فقط تجارب التكنولوجيا. وهذا يعني تحديد معايير النجاح مقدمًا، ووضع حواجز للأخلاقيات والامتثال، وتجنب فخ الطيارين الذين لا نهاية لهم بدون خطة للتوسع.”

بالنسبة لـ Puig، يبدأ العمل بإنشاء حالات استخدام قوية وأسس صارمة. “يجب على مدراء تكنولوجيا المعلومات التركيز على حالات الاستخدام القوية بما يكفي لتحقيق تأثير قابل للقياس. وفي مجال التعدين والمواد، يشمل ذلك ضمان سلامة البيانات من أرضية المصنع إلى أنظمة المؤسسة، ودمج الأمن السيبراني في سير عمل الذكاء الاصطناعي، ومراقبة المخاطر مثل التحيز أو انحراف النموذج.”

ويضيف بويج أن الثقة لا تقل أهمية عن التكنولوجيا. “تساعد الشفافية والحوكمة والتدريب الأشخاص على فهم كيفية اتخاذ قرارات الذكاء الاصطناعي وأين لا يزال الحكم البشري مهمًا. الهدف ليس مطاردة كل حالة استخدام لامعة؛ بل إنشاء إطار حيث يقدم الذكاء الاصطناعي القيمة بشكل آمن ومستدام.”

وتكرر نيكول كوغلين، مديرة تكنولوجيا المعلومات في مدينة كاري بولاية نورث كارولاينا، هذا الرأي. وقالت: “الأمر يتطلب الحوكمة والتعاون والشمول”. “المؤسسات التي تزدهر في مجال الذكاء الاصطناعي ستكون هي تلك التي تجمع الناس معًا – السياسات والشؤون القانونية والاتصالات والعمليات وتكنولوجيا المعلومات – للمشاركة في إنشاء حواجز الحماية. إن تقليل المخاطر لا يتعلق بإبطاء الابتكار. بل يتعلق بالمواءمة والهدف المشترك.”

المخاطر الرئيسية للذكاء الاصطناعي

وفقا لمؤلفي “إعادة توصيل الأسلاك: دليل ماكينزي للتنافس في عصر التكنولوجيا الرقمية والذكاء الاصطناعي“، كانت المخاطر والثقة دائمًا جزءًا من الذكاء الاصطناعي، لكن المشهد اليوم يزيد من المخاطر. لقد كتبوا أن “تحولات الذكاء الاصطناعي تظهر مجموعة جديدة تمامًا ومعقدة من المخاطر المترابطة. … تحدث ابتكارات الذكاء الاصطناعي في بيئة تتسم بزيادة التدقيق التنظيمي، حيث يشعر المستهلكون والمنظمون وقادة الأعمال بقلق متزايد بشأن نقاط الضعف في الأمن السيبراني وخصوصية البيانات وأنظمة الذكاء الاصطناعي.

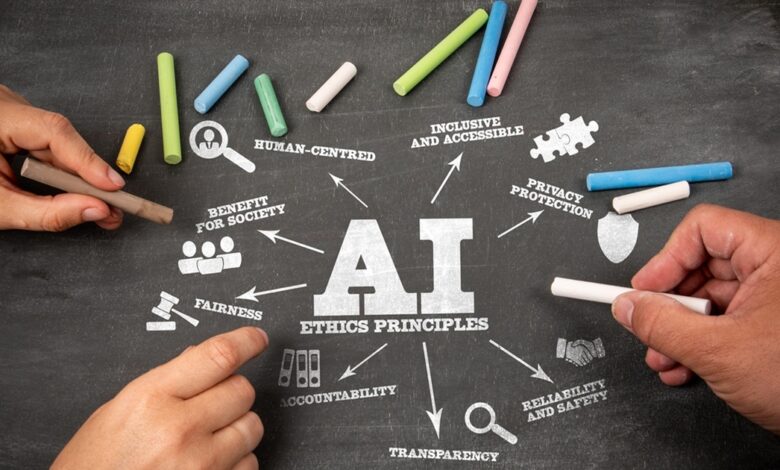

ونظرًا لهذا السياق، يقترحون على المنظمات إعطاء الأولوية لـ “الثقة الرقمية”. وهذا ينطوي على:

-

حماية بيانات المستهلك والحفاظ على الأمن السيبراني القوي.

-

تقديم منتجات وخدمات موثوقة تعمل بالذكاء الاصطناعي.

-

ضمان الشفافية حول كيفية استخدام البيانات ونماذج الذكاء الاصطناعي.

ويتطلب بناء هذه الثقة فرز المخاطر، وتفعيل سياسات المخاطر في جميع أنحاء المؤسسة، وزيادة الوعي حتى يفهم الموظفون دورهم في الذكاء الاصطناعي المسؤول.

في بحث Dresner Advisory Service لعام 2025، قمنا بفحص المخاطر الإضافية الفريدة للذكاء الاصطناعي التوليدي والفاعلي. هذه المخاطر – التي تتراوح من تعريف حالة الاستخدام إلى الأمان والخصوصية – أعاقت بلا شك إطلاق إنتاج حلول GenAI؛ تنطبق العديد من المخاوف نفسها أيضًا على الذكاء الاصطناعي الوكيل، والذي تم بناؤه على تقنيات أساسية مماثلة.

يظهر أمن البيانات والخصوصية كقضايا بالغة الأهمية، وقد ذكرها 42% من المشاركين في البحث. وفي حين أن المخاوف الأخرى – مثل جودة الاستجابة والدقة، وتكاليف التنفيذ، ونقص المواهب، والامتثال التنظيمي – تحتل مرتبة أقل بشكل فردي، إلا أنها تمثل مجتمعة عوائق كبيرة.

عند تجميعها، تشكل القضايا المتعلقة بأمن البيانات والخصوصية والامتثال القانوني والتنظيمي والأخلاق والتحيز مجموعة هائلة من عوامل الخطر – مما يشير بوضوح إلى أن الثقة والحوكمة هي الأولويات القصوى لتوسيع نطاق اعتماد الذكاء الاصطناعي.

حوكمة الذكاء الاصطناعي لتوليد الثقة

في جوهرها، تضمن الحوكمة أن البيانات آمنة لاتخاذ القرار والوكلاء المستقلين. في “المنافسة في عصر الذكاء الاصطناعي“، يوضح المؤلفان ماركو إيانسيتي وكريم لاخاني أن الذكاء الاصطناعي يسمح للمؤسسات بإعادة التفكير في الشركة التقليدية من خلال تشغيل “مصنع الذكاء الاصطناعي” – وهو محرك اتخاذ قرار قابل للتطوير يستبدل العمليات اليدوية بخوارزميات تعتمد على البيانات. ومع ذلك، لتحقيق مصنع الذكاء الاصطناعي، تحتاج المؤسسات إلى خط بيانات فعال يجمع البيانات وينظفها ويدمجها ويحميها بطريقة منهجية ومستدامة وقابلة للتطوير.

إن البديل لقياس هذا النوع من تصنيع البيانات هو نجاح تطبيقات ذكاء الأعمال. في بحث دريسنر لعام 2025، قالت 32% من المؤسسات التي شملتها الدراسة إنها حققت نجاحًا تامًا في تطبيقات ذكاء الأعمال الخاصة بها. وفي مناقشة مع ستيفاني وورنر من معهد ماساتشوستس للتكنولوجيا-CISR، أشارت إلى أن أرقام أبحاثهم الأخيرة كانت قابلة للمقارنة. وتشير هذه النتائج مجتمعة إلى أن أغلبية كبيرة من الشركات – ما يقرب من 68٪ – لم تقم بعد بإنشاء خطوط بيانات فعالة حقا.

لسد هذه الفجوة، يجب على المؤسسات إنشاء وامتلاك برنامج لإدارة البيانات – وهو الأمر الذي كان يكرهه مديرو تكنولوجيا المعلومات تاريخيًا ولكن يجب أن يتغير بشكل واضح في عصر الذكاء الاصطناعي. تتضمن الأساسيات ما يلي:

-

سلامة البيانات وجودتها: التأكد من دقة مصدر الحقيقة.

-

ملكية واضحة: تحديد المسؤول عن مجموعات بيانات محددة.

-

الإنصاف: مراقبة التحيز والحد منه بشكل فعال، إلى جانب ضمان عدم كشف البيانات واستخدامها للأغراض المشروعة فقط.

ويوضح كريس تشايلد، نائب رئيس قسم هندسة المنتجات والبيانات في شركة Snowflake، الأمر بهذه الطريقة: “الكفاءة بدون حوكمة ستكلف الشركات على المدى الطويل”. يضيف تشايلد أن الذكاء الاصطناعي الوكيل يزيد من التعقيد، لأن هذه الأنظمة المستقلة تعمل على البيانات مباشرة. وقال: “إن الطريق إلى الأمام هو توحيد البيانات والذكاء الاصطناعي والحوكمة في بنية واحدة آمنة”.

وفي الوقت نفسه، يوصي البروفيسور بيدرو أموريم من جامعة بورتو باتباع نهج “أسلوب المغامرة”: “تمويل العديد من الرهانات الصغيرة المحددة زمنياً، والتعلم بسرعة، ومضاعفة الفائزين من خلال طريق واضح نحو التصنيع”.

حوكمة الذكاء الاصطناعي لضمان أمن البيانات

تركز حوكمة المخاطر على حماية الوصول إلى البيانات. ويشير بوب ساينر – أحد رواد الفكر الرائدين في مجال حوكمة البيانات – إلى أنه من الأهمية بمكان إضفاء الطابع الرسمي على المساءلة وتثقيف الناس حول كيفية تحقيق عادات البيانات المحكومة. الأمان الفعال يعني منع الوصول غير المصرح به وفقدان السلامة والسرقة مع ضمان المعالجة المشروعة للمعلومات الشخصية.

يجادل إيانسيتي ولاخاني بأن الذكاء الاصطناعي الجدير بالثقة يتطلب “أنظمة مركزية لأمن البيانات وإدارتها بعناية، وتحديد الضوابط والتوازنات المناسبة بشأن الوصول والاستخدام، وجرد الأصول بعناية، وتزويد جميع أصحاب المصلحة بالحماية اللازمة”. نظرًا لأن LLMs تعتمد على كميات كبيرة من البيانات – بما في ذلك معلومات تحديد الهوية الشخصية – فيجب تأمين البيانات مقابل الطرق الفريدة التي تقوم بها LLMs بتخزين المعلومات واسترجاعها.

يقترح أموريم إنشاء حواجز الحماية هذه في وقت مبكر:

-

تصنيف البيانات وقواعد الخصوصية/الملكية الفكرية.

-

الإنسان في الحلقة لاتخاذ القرارات الحساسة.

-

معايير الحظر الصريحة ومعايير التقييم.

ويوصي أيضًا بالتأكد من وجود ميزانية في مقدمة مسار التحويل، حتى لا تضطر إلى القيام برهان كبير أو اثنين.

يوصي جاريد كويل، كبير مسؤولي الذكاء الاصطناعي في SAP، بإطار حوكمة يعتمد على ثلاث ركائز:

-

مناسب: وينبغي تصميم الذكاء الاصطناعي للعمل ضمن عملية تجارية محددة، وليس بطريقة “الذكاء الاصطناعي من أجل الذكاء الاصطناعي” المستقلة.

-

موثوق: يجب أن يلتزم النظام بمخرجات متسقة ودقيقة للبيانات.

-

مسؤول: يجب أن تكون العملية معتمدة، وتتبع إرشادات أخلاقية صارمة، وتستمر في البنية التحتية الأمنية الحالية.

كلمات فراق

يتطلب تحقيق القيمة باستخدام الذكاء الاصطناعي بيانات وعمليات صناعية وحوكمة قوية.

نقطة البداية بسيطة: يجب على مديري تكنولوجيا المعلومات التأكد من أن مبادرات الذكاء الاصطناعي الخاصة بهم ترتبط مباشرة بنتائج الأعمال، ووضع معايير نجاح واضحة، وتضمين حواجز الأخلاق والامتثال في وقت مبكر لتجنب فخ الطيارين الذين لا نهاية لهم والذين لا يتوسعون أبدًا.

ومن المهم بنفس القدر ثقة الشركات في الذكاء الاصطناعي. يحتاج مدراء تكنولوجيا المعلومات إلى سير عمل شفاف في الذكاء الاصطناعي، وأسس بيانات قوية، وتعاون متعدد الوظائف، وتدريب يساعد الموظفين على فهم كيفية اتخاذ قرارات الذكاء الاصطناعي – وأين يظل البشر هم المسيطرين.

تظل المخاطر أكبر عائق أمام GenAI والذكاء الاصطناعي الوكيل. يتصدر أمن البيانات والخصوصية القائمة، تليها الدقة والامتثال التنظيمي والتحيز والأخلاق – وهي مجموعة من المخاطر المترابطة التي تؤدي إلى إبطاء بدء الإنتاج.

إن الحكم الفعال هو السبيل الوحيد لتوفير خطوط البيانات الصناعية اللازمة لبناء الثقة. ويتطلب هذا إضفاء الطابع الرسمي على المساءلة، ومركزية منصات البيانات، وفرض ضوابط الوصول، وإنشاء حواجز حماية مبكرة – مثل تصنيف البيانات، وحماية الخصوصية، والرقابة البشرية – لضمان ملاءمة الذكاء الاصطناعي وموثوقيته ومسؤوليته.